💎 鉱石の採掘からインサイトの発掘へ

Core Keeper(コアキーパー) の地下バイオームを探索しているときでも、スモールビジネスの複雑なスプレッドシートと格闘しているときでも、「情報過多」は私たちのラスボスです。

RAG(検索拡張生成、Retrieval-Augmented Generation) システムは、AIに専用のガイドブックを渡すようなものです。一般的な学習データに頼るのではなく、ゲームのWikiや研究ノート、法的な契約書といった「あなた独自のデータ」を参照することで、ピンポイントで正確な答えを出してくれます。

ここでは、Gemma 3 4B と EmbeddingGemma を使って、プライベートなローカルナレッジベースを構築する方法をご紹介します。

🛠️ 「クラフト」ステーション(技術スタック)

これを作るにあたって、「ローカルファースト」のアプローチをとります。つまり、データがあなたのPCから外に出ることは決してないということです。秘密基地の座標(あるいは大切なクライアント情報)を安全に保つには完璧ですね。

- 頭脳(LLM):

gemma3:4b- Googleのコンパクトで非常に効率的なモデルです。 - 司書(エンベッダー):

embeddinggemma- 検索できるようにデータを「インデックス化」する特化型モデルです。 - サーバー: Ollama - 自分のPCでこれらのモデルを動かすためのエンジンです。

- インターフェース: AnythingLLM - チャット画面のような見た目ですが、文書保存などの面倒な作業をすべてこなしてくれる使いやすいアプリです。

メモ:2026年のローカルAIの最高の魅力の一つは、ツールが「プラグアンドプレイ」であることです。技術的なスキルに合わせて、サーバーとUIを自由に組み合わせて使うことができます。たとえば、Ollamaの代わりにLM Studioを使ったり、AnythingLLMの代わりにOpen WebUIを使ったりすることも可能です。色んなツールを試してみてください!

📖 ステップ1:素材を集める

まずは、「信頼できる情報源(Source of Truth)」を特定しましょう。

- ゲーマーなら: ボスの攻略法やクラフトのレシピをまとめるために、Core Keeper Wiki を使ってみましょう。

- プロフェッショナルなら: PDFのフォルダやプロジェクトのログ、あるいは専門的なウェブサイトなどが該当します。

⚙️ ステップ2:ワークショップの準備(Ollama)

(ちょっとしたヒント:このような4Bモデルをスムーズに動かすには、約8GBのVRAMがあると良いですよ!)

Ollamaをダウンロードして、ターミナルで以下の2つのコマンドを実行し、「モデル」をダウンロードしてください。

# Download the language model

ollama pull gemma3:4b

# Download the embedding model

ollama pull embeddinggemma

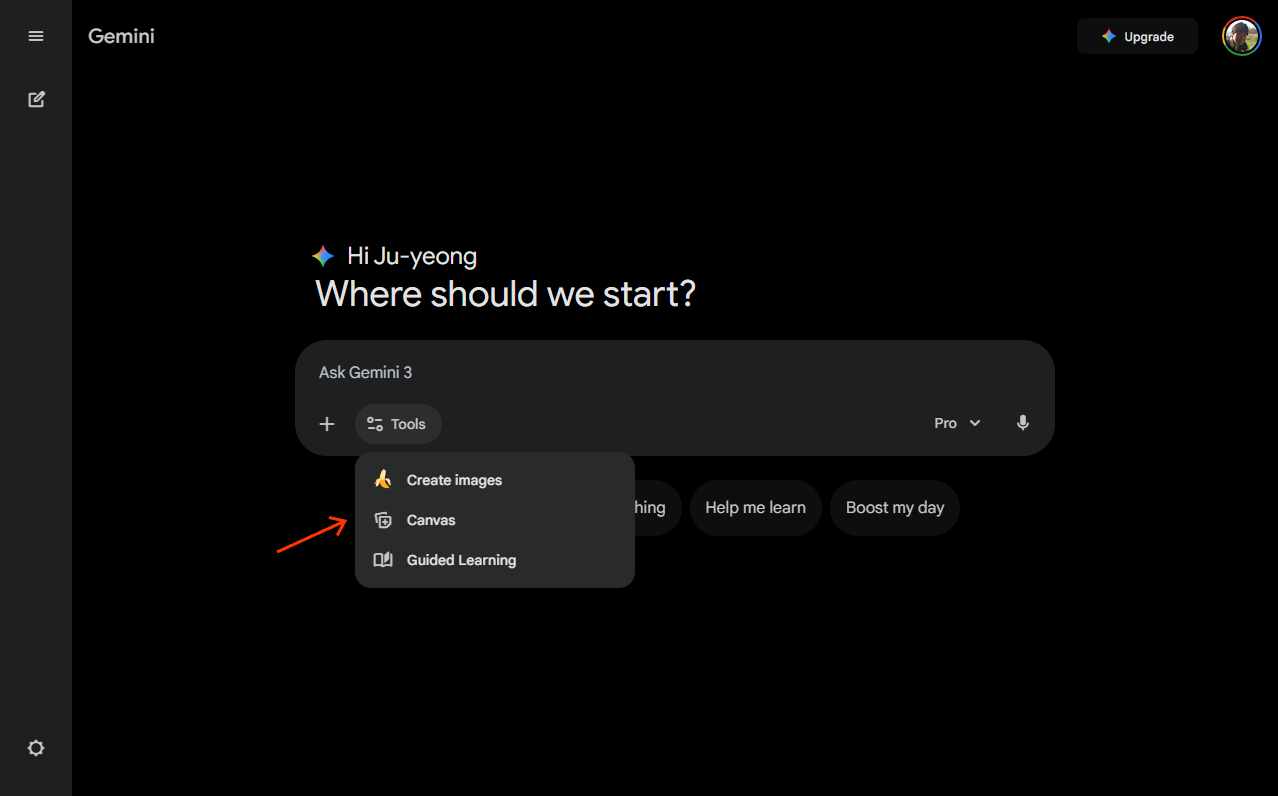

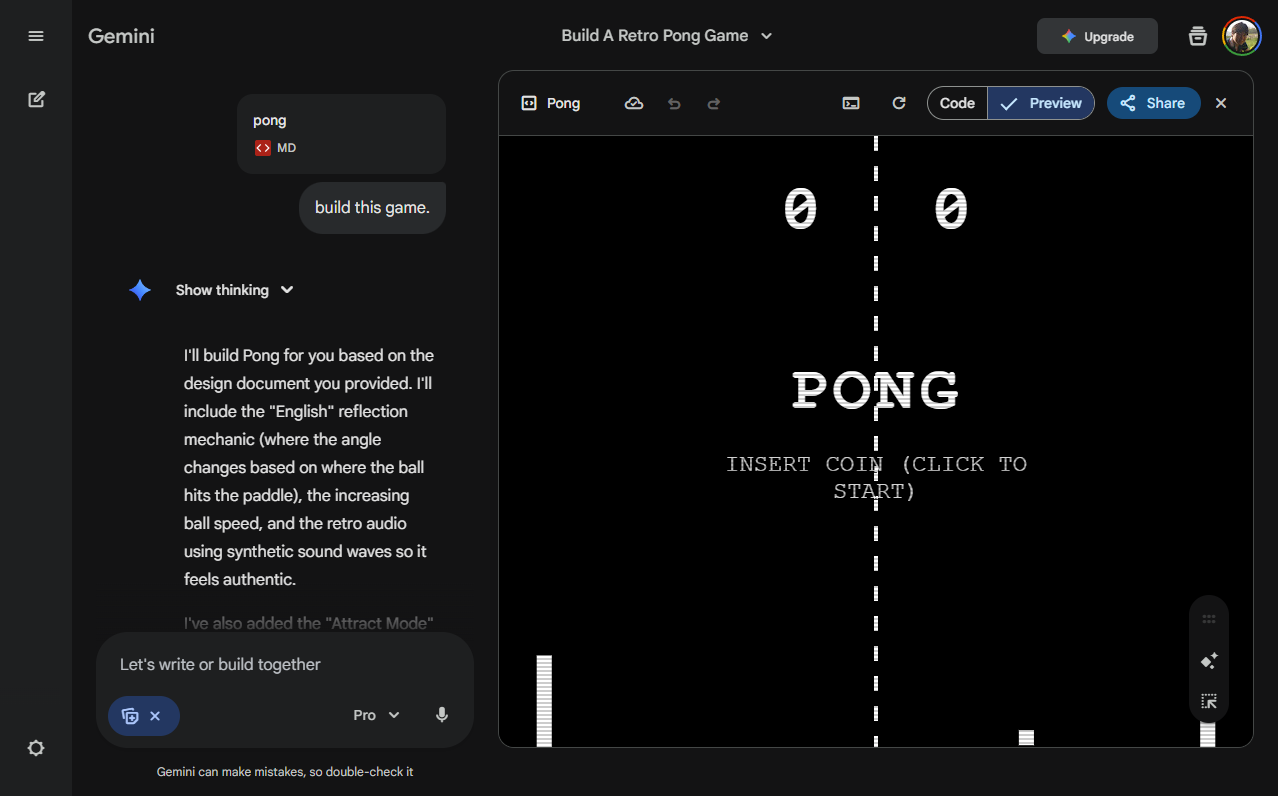

🖥️ ステップ3:インターフェースの設定(AnythingLLM)

AnythingLLMを開き、以下の手順に従ってモデルを連携させます。